stage3day1section2-3

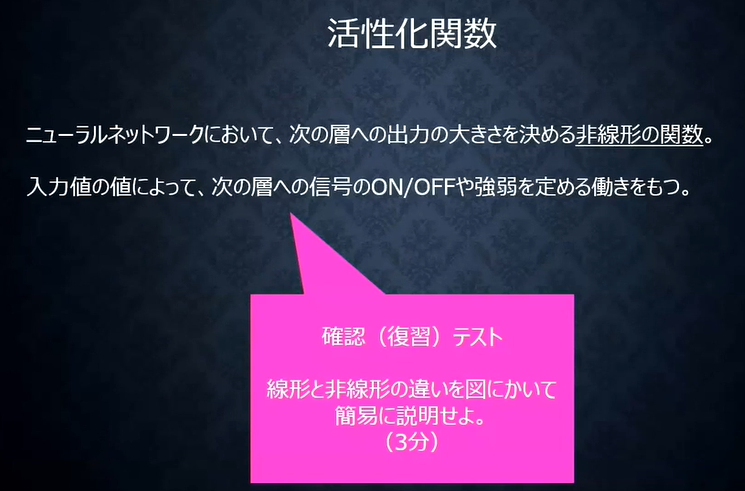

Section2:活性化関数

確認テスト

答え

線形

直線で表現できる y= ax + b *2次元

平面で表現できる *3次元

非線形

直線で表現できない *2次元

平面で表現できない *3次元

活性化関数 層によって違う

中間層用の活性化関数 ・ReLU関数 ・シグモイド(ロジスティック)関数→勾配消失点問題あり ・ステップ関数

出力装用の活性化関数 ・ソフトマックス関数 ・恒等写像 ・シグモイド(ロジスティック)関数→勾配消失点問題あり

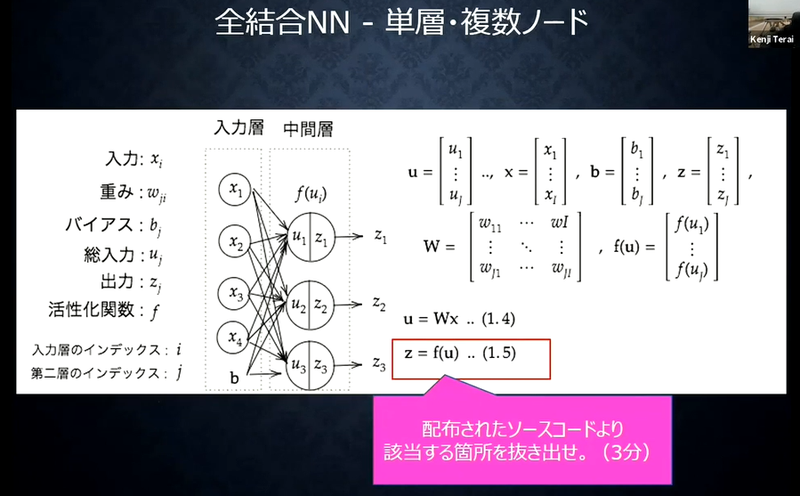

確認テスト

答え

z1 = functions.relu(u1)

Section3:出力層

出力層では、人間に分かる形での数値を出力する

クラス分けであれば、そのクラスである確率、など

訓練データ 動物のクラス分けであれば、人間が判断した正解データ

誤差関数 NNで出力したものと訓練データ(正解)との誤差

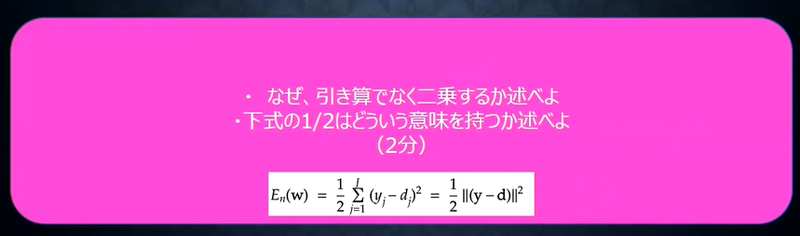

確認テスト

答え

・正の誤差と負の誤差が打ち消しあう可能性があり、訓練データとの差を正しく表現できない

なので正も負も、正解からの差の絶対値となるよう二乗している

・誤差関数の微分を用いる際の計算式を簡単にするため。

出力層での活性化関数

→分類問題の場合、0-1の範囲に限定され、総和は1となる

回帰に用いる出力層の種類

・活性化関数→ 恒等写像

・誤差関数→二乗誤差

二値分類に用いる出力層の種類

・活性化関数→シグモイド関数

・誤差関数→交差エントロピー

多クラス分類に用いる出力層の種類

・活性化関数→ソフトマックス関数

・誤差関数→交差エントロピー

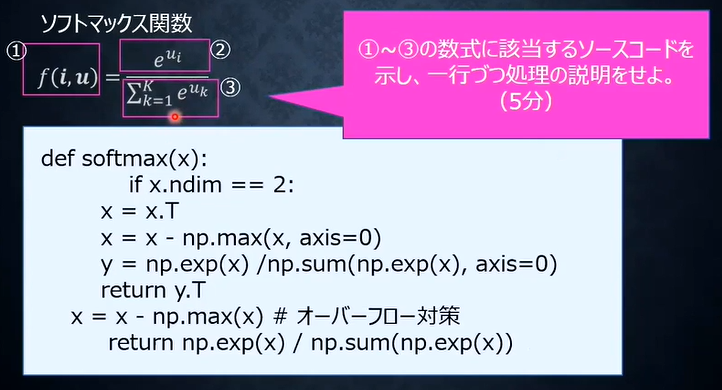

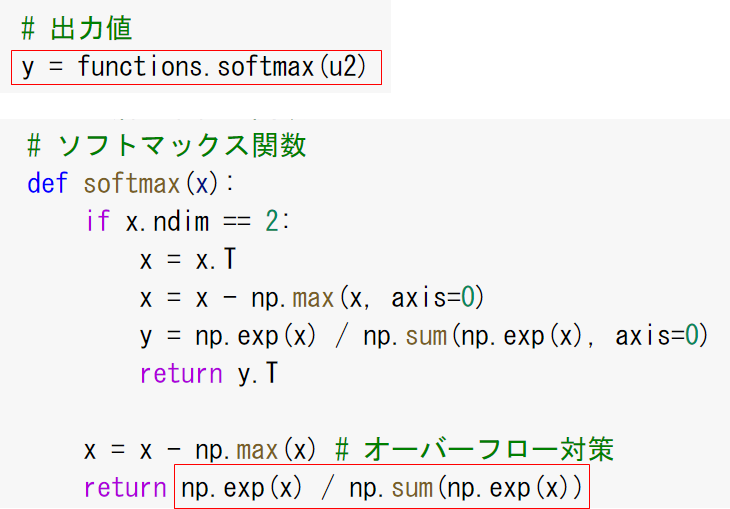

確認テスト

答え

①はソフトマックス関数を通した後の出力

②/③はそのクラスに属する確率

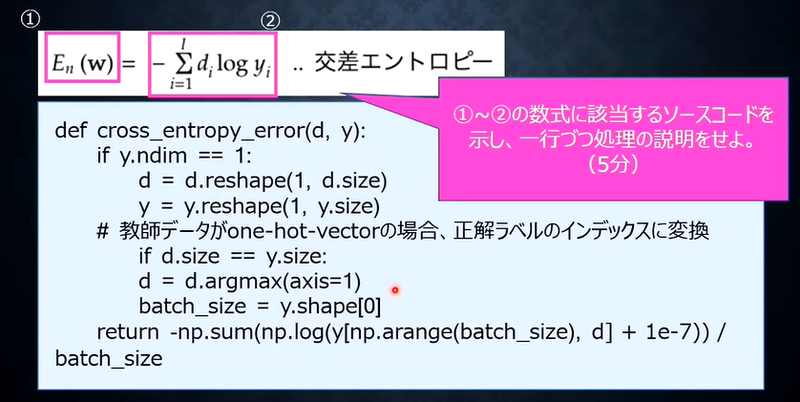

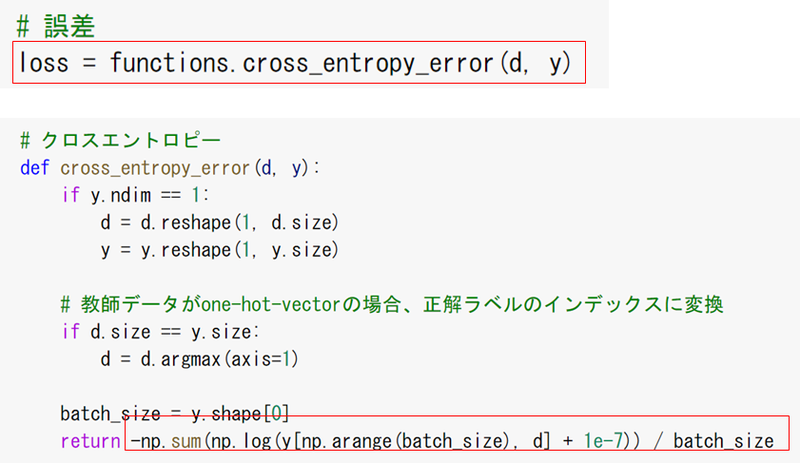

確認テスト

答え

①誤差関数にクロスエントロピーを指定

②クロスエントロピー誤差を計算

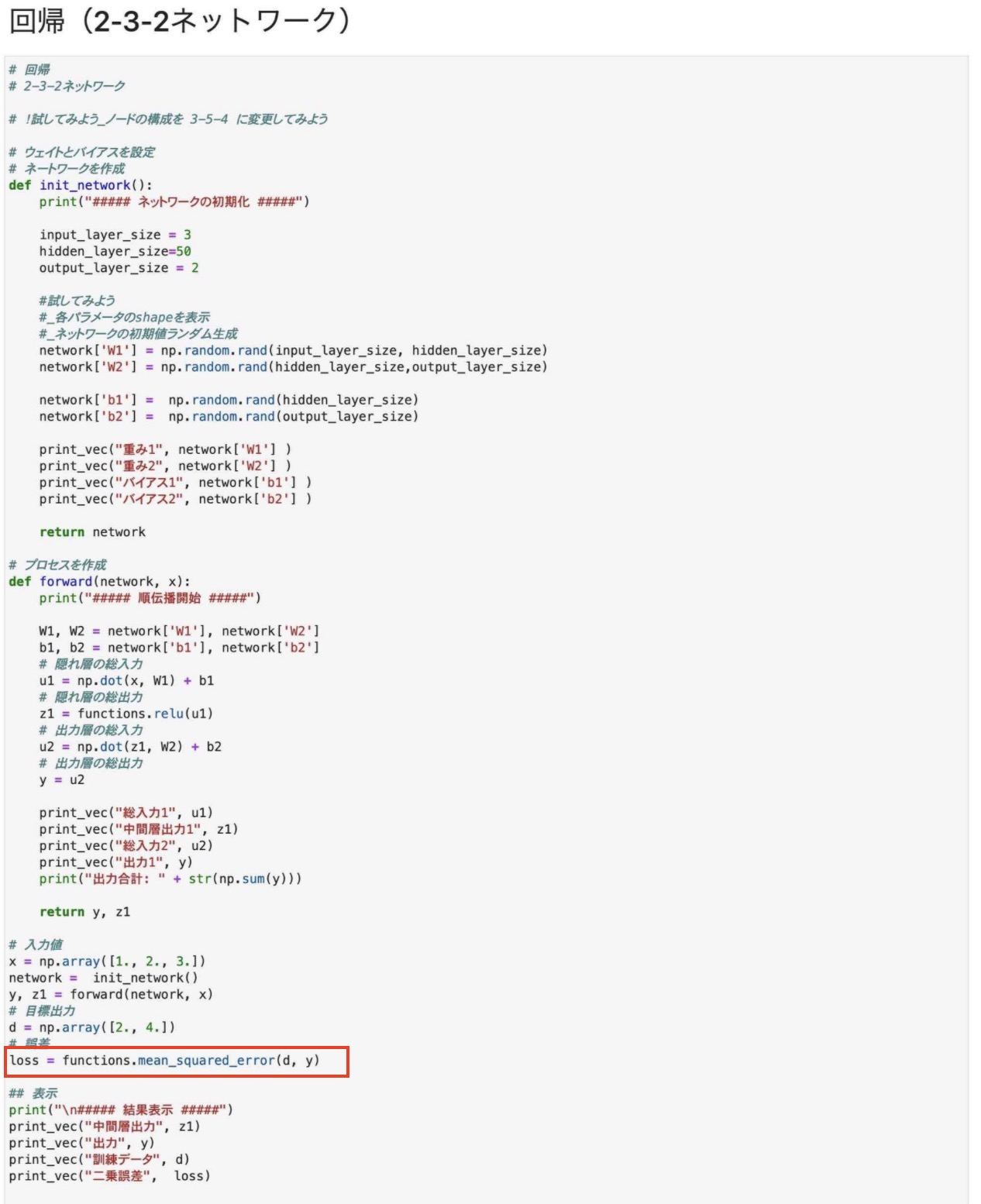

実装演習

誤差関数は解く問題によって使うものが決まっている。

分類問題ではクロスエントロピー誤差を使うことがおおいが今回は平均二乗和誤差を利用